算力即國力:2024 年起,再怎麼重視 “異構芯片” 都不為過

算力即國力,異構 AI 芯片市場迅速崛起。微軟聯合創始人比爾·蓋茨與 OpenAI 首席執行官山姆·奧特曼預計,人工智能將引發一次技術革命,系統計算能力將達到 GPT-4 的 10 萬倍或 100 萬倍。中國市場各互聯網和雲公司積極囤積 GPU,甚至上市公司也加入採購隊伍。為解決 GPU 供應短缺和成本問題,市場湧現各類異構 AI 芯片。全社會學習異構 AI 芯片的熱潮席捲各行各業,企業領導幹部也需要了解。計算機原理為了解異構 AI 芯片提供基礎。

進入大模型時代,全社會算力需求被推高到了前所未有的程度。

2024 年 1 月,微軟聯合創始人比爾·蓋茨與 OpenAI 首席執行官山姆·奧特曼進行了一次對話,奧特曼在對話中表示人工智能將引發人類歷史上 “最快” 的一次技術革命,人類可能還沒有準備好以多快的速度適應這種變革。奧特曼預計,這項技術將迅速發展,使系統的計算能力達到 GPT-4 的 10 萬倍或 100 萬倍。簡單來説,用於人工智能計算的英偉達 GPU 芯片遠遠不夠用了。

2024 年 1 月,Meta 公司 CEO 扎克伯格宣佈到今年年底將需要大約 35 萬塊英偉達 H100,將其他 GPU 包括在內的話,算力總水平相當於近 60 萬塊 H100,而 60 萬塊 H100 的採購費用保守估計約 90 億美元。

在中國市場,不僅阿里、騰訊等互聯網和雲公司紛紛囤積 GPU,甚至像蓮花味精這樣的上市公司也斥資 6.93 億採購了 330 台英偉達 H800 GPU,更不用説各種在建智算中心。而為應對 GPU 全球供應短缺問題,以及美國對 GPU 的出口限制問題,當然更重要的是在 AI 場景下降低成本,於是市場上湧現了各類異構 AI 芯片。

由於大模型 AI 對於全社會的重要性,以及各行各業加快建設智算中心,也引發了全社會學習異構 AI 芯片的熱潮,即使是企業領導幹部也需要了解一些異構AI芯片的知識。

01 從基本的計算機原理講起

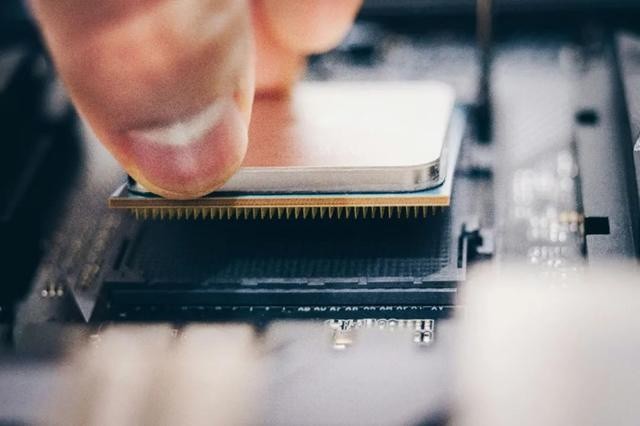

在瞭解相關 CPU、GPU 等異構 AI 芯片的知識之前,讓我們先來了解一下基本的計算機原理。

現代計算機由處理器、內存、I/O(輸入/輸出)設備三大部分構成。在處理器方面,一直以來都遵循馮·諾依曼架構,即處理器也是一個系統。處理器又叫中央處理單元(Central Processing Unit),即 CPU。程序員通過輸入設備發出指令,經過 CPU 和內存的處理,再將處理結果發送到輸出設備。

ISA 指令集體系結構是處理器與程序員進行交互的方式,指令集是處理器指令的完整集合,體系結構是處理器系統的構建方式,特定的處理器需要配備相應的指令集,才能與程序員交互。32 位處理器是指能夠處理 32 位指令和數據的 CPU 和計算機架構;64 位處理器是指能夠處理 64 位指令和數據的 CPU 和計算機架構。

RISC 即精簡指令集計算機架構,CISC 即複雜指令集計算機架構,英特爾 X86 是典型的 CISC 架構,而 MIPS(適用於嵌入式和消費級設備)和 ARMv8 架構(適用於移動設備、服務器、網絡設備、物聯網設備等)都是典型的 RISC 架構。RISC-V 是一個基於 RISC 原則的開源指令集架構,RISC-V 指令集可以自由地用於任何目的,允許任何人設計、製造和銷售 RISC-V 芯片和軟件。

CISC 架構適用於通用計算任務的計算機。既然要完成各種通用計算任務,勢必帶來指令集的冗餘,因此 CISC 指令集中只有約 20% 的指令會經常被用到,其餘 80% 的指令則不經常被用到,這些不經常被用到的特殊指令讓 CPU 的設計變得非常複雜,也導致 CPU 的面積越來越大。而 RISC 架構只包含處理器常用的指令,對於不常用的操作,通過執行多條常用指令的方式來達到同樣的效果。

02基礎芯片,從CPU到ASIC

CPU

理解了這些最基本的概念,讓我們來看一看 CPU、GPU、FPGA、ASIC 這幾種最基礎的異構芯片。CPU 通常指英特爾 X86,AMD 公司也生產 X86 架構 CPU。X86 架構最早出現在上世紀 70 年代末的 Intel 8086 處理器上,後發展為 80286、80386、80486 等,逐步演化為現代的 X86 架構。

X86 架構的特點包括屬於 CISC 架構,X86 架構在個人計算機、服務器和工作站市場佔主流地位,具有很高的兼容性,能夠運行大量軟件和操作系統,無需重新編寫或修改就可以移植軟件,X86 架構引入了 64 位處理器,能夠處理更大的內容和數據,而由於 X86 架構支持多核心處理等,適合運行虛擬機,因而也在虛擬化和雲計算中得到了廣泛應用。

當然,在英特爾和 AMD 之前是大型主機和小型機的年代。整個現代 PC 產業主要指 X86 架構的個人計算機、服務器和工作站以及基於這些硬件的軟硬件生態。而整個現代 PC 產業和之前的小型機產業都是 IBM 大型主機技術降維應用的紅利。

在 1960 年代初,IBM 投入了 50 億美元開發大型主機,這相當於今天接近 400 億美元的投資。1969 年,人類第一位宇航員登陸月球,而在阿波羅登月項目中,IBM 大型主機 System360 做出了重要貢獻。IBM 大型主機技術孵化了後來的小型機以及整個現代 PC 與 PC 服務器產業。

與 PC 和 PC 服務器不同,大型主機和小型機都是高度集成的系統,而不像 X86 那樣易用化、模塊化、工業標準化,從而支撐起龐大的軟件產業和用户羣。

今天,大型主機和小型機仍然在進化和使用中,但其用户羣主要集中在頂級金融機構或對性能和安全性要求超高的企業或政府機構。大型主機和小型機的 CPU 處理器與 X86 架構 CPU 處理器不同,目前主要由 IBM 維護和推出新的大型主機與小型機 CPU。

在馮·諾依曼架構下,CPU 也是一個系統,今天已經發展成為超大規模集成電路。X86 CPU 從單核到雙核以及包含更多核心的 CPU,越來越複雜、性能也越來越高。最新的第五代英特爾至強服務器 CPU 最高支持 64 個核心,AMD 已經發布的第四代 EPYC 霄龍服務器 CPU 最高支持 96 個核心;而根據有關披露,即將發佈的第六代至強服務器 CPU 最高將支持 288 個核心(能效核)。

當然,僅從核心數量並不能判定 CPU 性能的高低,英特爾與 AMD 對於核心的定義也各不相同。但一個 CPU 處理器內將容納更多的核心,甚至是異構芯片,將是 CPU 的發展趨勢。

PCIe 是一種高速串行計算機擴展總線標準,是當前主流的片間互連高速總線,為主板上的各類外設以及擴展卡等提供與 CPU 之間的高速連接。PCIe 由 PCI 發展而來,PCI 外設組件互連總線由英特爾公司在 1991 年推出,允許在當時的計算機內安裝多達 10 個遵從 PCI 標準的擴展卡。PCIe 擴展了 PCI 的性能,支持邏輯隔離的多個虛擬設備。

ASIC

再回到指令集和指令集架構。在現代計算機產業中,根據指令的複雜度,處理器分為 CPU、Coprocessor 協處理器、GPU(圖形處理器)、FPGA(現場可編程門陣列)、DSA(特定領域加速器)和 ASIC(專用集成電路)等,按從 CPU 到 ASIC 的順序,通用性、靈活性和成本不斷降低,面積也越來越小,但在應對特定計算場景的性能不斷提升,其中 CPU 是能夠獨立運行的處理器,其它處理器則需要在 CPU 的協助下運行。

接下來先看一下 ASIC 專用集成電路。ASIC 與 CPU 可以説是天平的兩端,CPU 是一個硬件與軟件解耦的架構,而 ASIC 是硬件與軟件高度集成的架構。ASIC 為特定應用而設計,可以通過定製化設計,以滿足特定應用的需求。

與通用芯片相比,ASIC 具有更高的效率和更低的功耗。由於 ASIC 是完全不可編程的定製處理引擎,因此理論上也具有最複雜的 “指令” 以及最高的性能效率。因為每種 ASIC 可覆蓋的場景非常小,因此需要數量眾多的 ASIC 處理引擎,才能覆蓋各類場景。

例如,在網絡交換機中常採用 ASIC 芯片,用於交換機所有端口之間直接並行轉發數據,以提高交換機高速轉發數據性能;ASIC 也被用於各種汽車系統,包括 ADAS 高級駕駛員輔助系統、發動機控制單元和信息娛樂系統等;在消費電子設備、醫療設備和工業控制系統中,也大量應用了 ASIC 芯片。

進入人工智能時代,ASIC 芯片還被用於 NPU、TPU 等人工智能算法專用芯片。由於 ASIC 廠商眾多,不同的 ASIC 廠商推出各種的編程語言,可謂五花八門、各不相同,因此 ASIC 芯片很難培養起龐大的生態。

FPGA

理解了 ASIC,那麼 FPGA 就是處於 CPU 與 ASIC 之間的一種集成電路。FPGA 又稱現場可編程門陣列,是 ASIC 專用集成電路領域中的一種半定製電路,是可重複編程的設備。

一般來説,FPGA 比 ASIC 的速度慢,實現同樣功能要比 ASIC 電路面積大,功耗、成本等都高於 ASIC,但是可以快速成品,可以被修改。由於可重複編程的特點,FPGA 的通用性要比 ASIC 更好。FPGA 無需像 ASIC 設計那樣要經過數百萬美元的流片階段,也不用承擔流片失敗的風險。

因此,FPGA 通常用於 ASIC 芯片的驗證。 FPGA 本質上是並行計算,這種並行處理能力使得 FPGA 在高速數據處理的應用中表現出色,例如數字信號處理、圖像處理和加密等。

同樣,在人工智能時代,FPGA 也被用於人工智能算法處理。特別是 AI 算法推陳出新,對硬件的算力及靈活度都有較高要求,而 FPGA 正好符合了這樣的需求。

DSA

接下來看 DSA 特定領域加速器。DSA 是一種針對特定領域定製的可編程處理器,能夠用於加速某些應用程序,實現更好的性能和性價比。DSA 介於 FPGA 與 ASIC 之間,ASIC 是完全不能編程的軟硬件高度集成的定製芯片,FPGA 是面向不同領域的可編程處理器,而 DSA 則是專門面向特定領域的可編程處理器。

由此可見,DSA 的靈活性在 FPGA 與 ASIC 之間,成本、功耗等也在二者之間。DSA 的好處就是能夠面向特定領域,形成自己的生態,只要該領域的市場足夠大,比如人工智能計算加速、圖形渲染加速等。某種程度上,GPU 就是基於 DSA 思路而設計開發的產品。

隨着摩爾定律的失效,現代計算機專家們認為 DSA 能夠提高 CPU 處理器的效率和速度。2017 年,圖靈獎獲得者 John Hennessy 與 David Patterson 聯合發表了 “計算機體系架構的黃金年代” 文章,指出由於目前通用計算的性能瓶頸,需要面向不同應用場景開發針對性優化的架構,他們給出的解決方案就是 DSA。

DSA 既是一種架構,也是一種設計理念。狹義的 DSA 基於 ASIC 實現,廣義的 DSA 基於 FPGA 實現,或者基於顆粒度更小的 Chiplet 小芯片集成起來實現。

所謂 Chiplet,即將一個大芯片裸片(Die)切成小芯片,切下來的小芯片是已經完成了設計、製造、測試流程的成品小裸片,只需要一次封裝加工就可以使用,既可以複用給其他芯片,也可以將眾多 Chiplet 集成起來實現新的功能。DNN 深度神經網絡是 DSA 應用的一個重要領域。

GPU

那麼接下來讓我們瞭解一下當下最火爆的 GPU。GPU 又稱圖形處理器,目前分為消費級 GPU 和數據中心級 GPU。消費級 GPU 主要用於遊戲電腦、設計、3D 顯示等場景,而數據中心級 GPU 主要用於人工智能場景。

CPU與GPU最大的區別之一是CPU是基於串行計算,而GPU是基於並行計算,這讓GPU天然就適合基於並行計算的人工智能算法。

GPU 作為一種 DSA,在設計上就是專門為了需要大規模並行計算的圖形處理而生,因此 GPU 的核心數通常遠超 CPU,可達 512 核甚至更多,但 GPU 也沒有 CPU 上那麼 多適用通用計算的組件。典型的 GPU 廠商有 NVIDIA 英偉達、AMD、英特爾等。

首個現代通用 GPU 架構(即 GPGPU)由英偉達在 2006 年推出,這就是 Tesla。Tesla 採用全新的 CUDA 架構,支持 C 語言對 GPU 編程,可用於通用數據的並行計算,標誌着 GPU 開始從專用圖形處理器轉變為通用數據並行處理器。

隨着英偉達公司發佈 NVIDIA GPU 專用編程庫 CUDA,AMD 和 Apple 等公司推出開源的 OpenCL(Open Computing Language, 開放設計語言,是一個為異構平台 CPU/GPU/DSP/FPGA 等等進行編程設計的框架),GPU 開始在通用計算領域得到廣泛應用,如數值分析、海量數據處理、金融分析等等。

近年來,隨着人工智能的大火,GPGPU 也在深度學習算法等人工智能計算中廣泛應用。數據中心級 GPU 就是為了人工智能的智算需求而生,英偉達 A100、H100 被認為是功能最強大的數據中心級 GPU,也是各大人工智能公司、雲廠商、互聯網公司等競相爭奪的資源。

Co-processor協處理器

所謂協處理器,顧名思義即協助 CPU 中央處理器完成各種計算任務的處理器,特別是協助中央處理器完成無法執行或執行效率、效果低下的處理任務而開發和應用的處理器,例如數學協處理器、圖形協處理器、音頻協處理器、網絡協處理器或手機上的運行協處理器等。

協處理器通常被集成在計算機的主板或者 CPU 內部,也可以作為外部設備連接到主板上。例如,早期的圖形協處理器 Intel 82786,而今天的英特爾 GPU 也開始具備更強的能力,以應對英偉達對於 GPU 市場的壟斷。

風險提示及免責條款

市場有風險,投資需謹慎。本文不構成個人投資建議,也未考慮到個別用户特殊的投資目標、財務狀況或需要。用户應考慮本文中的任何意見、觀點或結論是否符合其特定狀況。據此投資,責任自負。