文心一言如何商業化?百度已有初步落地圖譜

對比其他家聚焦協同辦公賽道、發佈單個獨立應用的 “小而美” 路徑,百度明顯走的是 “大而全” 模式,讓智能雲大模型平台扮演技術落地 “抓手” 角色,將文心一言能力應用至辦公、電商、旅遊、金融、政務等場景。

作者 | 張超 編輯 | 羅麗娟

“閉關” 一個多月,百度大語言模型、生成式 AI 產品文心一言公佈了首份 “成績單”:完成 4 次技術版本升級、推理成本降為原來的十分之一、算力利用率提升 1 倍。

雖然這次透露的數據不多,但都是涉及軟件技術的關鍵指標。簡言之,文心一言不僅實現了模型性能提升、成本優化,還保持着大約每週升級一次的水平。

從技術研發到場景落地,中間需要一個觸達用户的 “抓手”,目前看來,百度智能雲大模型平台扮演的就是這個角色。

自 3 月底開始,平台已經向首批企業客户啓動內測,目前已經與智能辦公、旅行服務、電商直播、政務服務、金融服務等領域客户聯合研發,共同打造行業 “樣板間”;未來將針對不同客户和開發者的需求,提供多種服務模式。

按照百度的計劃,其智能雲的六大智能產品系列,都將基於文心一言全面升級,在安全評估完成後上線。

隨着 AIGC 浪潮席捲中國,各家互聯網大廠掀起了一輪 “大模型混戰”,甚至 “默契” 地將協同辦公選為了技術落地首站,爭搶着發佈相關智能化產品。

但百度作為中國第一個發佈類 ChatGPT 產品的企業,卻是本輪相對較晚公佈技術實際應用產品的企業。

不過,對比其他企業聚焦協同辦公賽道、發佈單個獨立應用的 “小而美” 路徑,百度明顯走的是 “大而全” 模式,直接公佈了具備大模型能力的平台,覆蓋領域除了辦公,還涉及電商、旅遊、金融、政務等方面。

需要注意的是,所有這些能力仍處在內測階段,與全面上線公開使用始終是兩回事。

文心一言落地之路,才剛剛開始。

“滿月” 成績首公開

在上海近日舉行的一場技術交流會上,百度智能雲公佈:

自 3 月 16 日公開亮相以來,文心一言推理服務已完成 4 次迭代,目前已升級至 3.5 版本。在業內首創支持動態插入的分佈式推理引擎,單機 QPS(每秒查詢率)相對線上版本提升 123%。

模型推理效率方面,相對於第一版大模型推理服務,單機 QPS 累計提升近 10 倍。這意味着大模型推理的成本降低為原來十分之一,換句話説,可以併發為原來 10 倍數量的用户提供服務。

模型推理性能方面,已經提升了 50%。性能的提升意味着模型效果提升,即文心一言進化更快了,學習又快又好了。大模型需要在用户反饋中持續不斷的學習,推理作為大模型應用的關鍵,其性能的提升直接影響到產品側呈現效果。

而在模型算力方面,利用率也提升了 1 倍。據悉,這部分 “降本增效” 貢獻的主要來自百度深度學習平台——飛槳。

大模型需要深度學習框架來支撐其高效、穩定的分佈式訓練。飛槳一方面與大模型的訓練和部署進行協同優化,另一方面向下承接芯片,相當於芯片的 “指令集”,適配優化後激發芯片的潛力,從而提升模型算力利用率。

雖然這張 “成績單” 上的數據不多,但卻是關乎模型運行效率、性能、成本等的關鍵性指標。

隨着巨頭玩家加入、行業認知加深,越來越多人對大模型研發達成一個共識:這是個 “燒錢” 的行當,沒有雄厚資金支持恐怕寸步難行。

研究公司 SemiAnalysis 的首席分析師 Dylan Patel 近期在接受媒體採訪時就表示,考慮到 AI 需要昂貴的技術基礎設施才能順暢運行,用户們在 ChatGPT 上撰寫求職信、生成課業規劃和在約會應用上潤色個人簡介等操作,每天可能燒掉 OpenAI 多達 70 萬美元,每次查詢要花掉 36 美分。

這個估算還只是在 ChatGPT-3 模型上,為了根據用户提示快速做出反應,ChatGPT 就需要時刻工作,不斷消耗算力。Dylan Patel 判斷,ChatGPT-4 的服務開銷只會更高。

但任何一次性能升級、算法優化或是算力提升,對大模型研發企業而言,都是一次效率的優化,從另一個角度看也實現了降本,因此沒有一家會放棄升級技術。

“我們最近一個月在性能優化上做了非常多的工作,” 百度智能雲 AI 與大數據平台總經理忻舟透露,已經通過硬件優化、框架優化讓文心一言有了極大提升,但他坦言,從目前可見的技術看,“其實還是有進一步優化空間。”

落地場景和商業化

模型技術的推廣,很大程度取決於應用能力和輻射範圍。落地,是各科技企業長期要思考解決的議題。

而百度智能雲大模型平台,就是文心一言試點落地的 “抓手”。根據百度方面介紹,其智能雲大模型平台是 “全球首個一站式企業級大模型平台”,最大特點即 “一站式”,不但提供包括文心一言在內的大模型服務,也支持各類第三方開源大模型,還提供開發 AI 應用的各種工具鏈及整套環境,旨在打造成大模型生產和分發的集散地。

百度智能雲 AI 與大數據平台總經理忻舟

按照服務模式劃分,百度智能雲大模型平台可根據根據不同企業及開發者需求,提供公有云服務、私有化部署兩大服務模式。

其中,在公有云服務方面,百度智能雲大模型平台將提供推理、微調和託管三種服務,以降低企業部署大模型的門檻。

從技術層面可以將三大服務能力理解為:推理就是直接調用大模型的推理能力,輸出推理結果;微調則是在通用大模型的基礎能力上,客户可根據自己的需求,注入少量行業數據,從而用很小成本微調出一個自己專屬的大模型;託管指利用通用大模型或者微調出來的行業大模型,直接託管在百度智能雲的雲端。

在私有化部署方面,百度智能雲大模型平台支持軟件授權、軟硬一體兩種方式;前者提供在企業環境中運行的大模型服務,後者則是提供整套大模型服務及對應的硬件基礎設施。

實際應用過程中,各種技術能力不可避免會交叉呈現在場景中。百度表示,其是國內唯一將大模型在實際應用中大規模落地的公司,截至目前有 14 萬企業申請加入文心一言。

雖然文案創作、智能對話、辦公提效、代碼生成、數據分析等是目前高頻應用場景,但據百度介紹,其正在政務、金融、智能辦公、電商、旅遊等領域探索測試。

“我們希望能接觸更多的場景,給各行各業都做一些樣板間。” 忻舟透露,需求量是目前百度考慮將文心一言推廣落地的因素之一,會與需求量較高領域的頭部企業共同打造標杆、及時地推到市場,同時也想覆蓋更多行業、更多場景。

區別於其他家目前集中在協同辦公領域的大模型技術展示,百度智能雲大模型平台現場不僅呈現了文心一言製作 PPT 的能力,還展示了其在金融、電商等場景下的技術內測情況。

可以看到,在企業辦公場景下,用户只要啓動 “PPT 生成助手”、文字提出需求 “主題是長安汽車介紹,不超過 10 頁”,文心一言即可自動生成內容大綱、設計排版;後續還可以根據用户需求對具體 PPT 進行調整。

百度預計,未來僅需 3 分鐘,文心一言就可以做出來一份格式精美、內容豐富的 PPT。

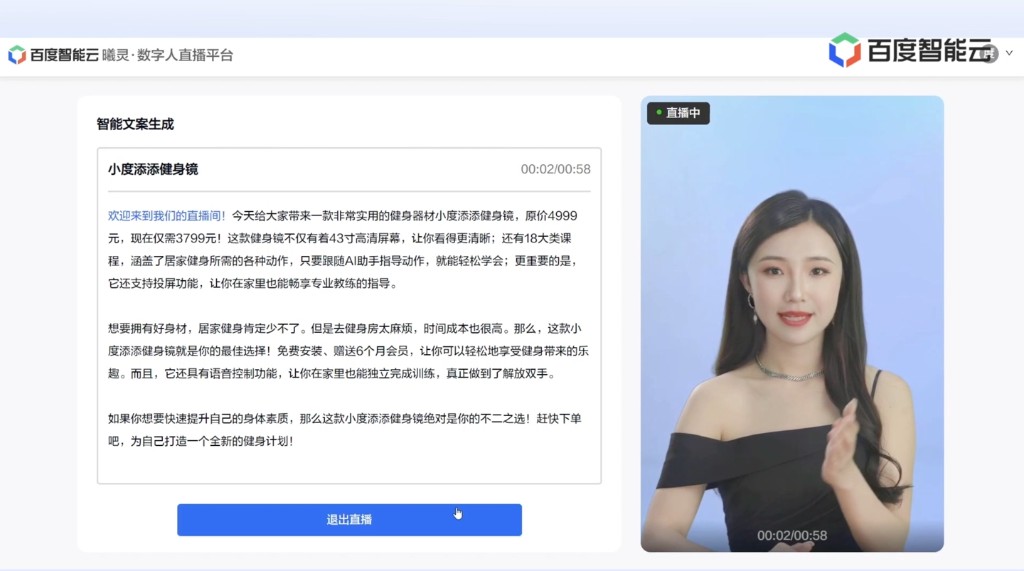

電商場景下,接入文心一言後,用户鍵入商品基本信息,就可以自動生成不同風格的營銷文案,再一鍵開啓數字人直播,便可以幫商家實現 7x24 小時不間斷直播帶貨。

按照忻舟的説法,從技術特點上分析,除了通常看到的微調、指令學習等技術外,百度大模型其實融入了知識圖譜和搜索,所以在實時性問題、知識性問題上會做得更好;另外,作為國內最早提出、最早推出 AI 大模型的平台,百度能得到更多、更新的反饋。

所以,即便不少企業都公佈了自己的 “AI 助手” 應用,百度仍然認為其在長期競爭中具有優勢,但公司並未公佈文心一言的調用收費模式。

行業規則正被改寫

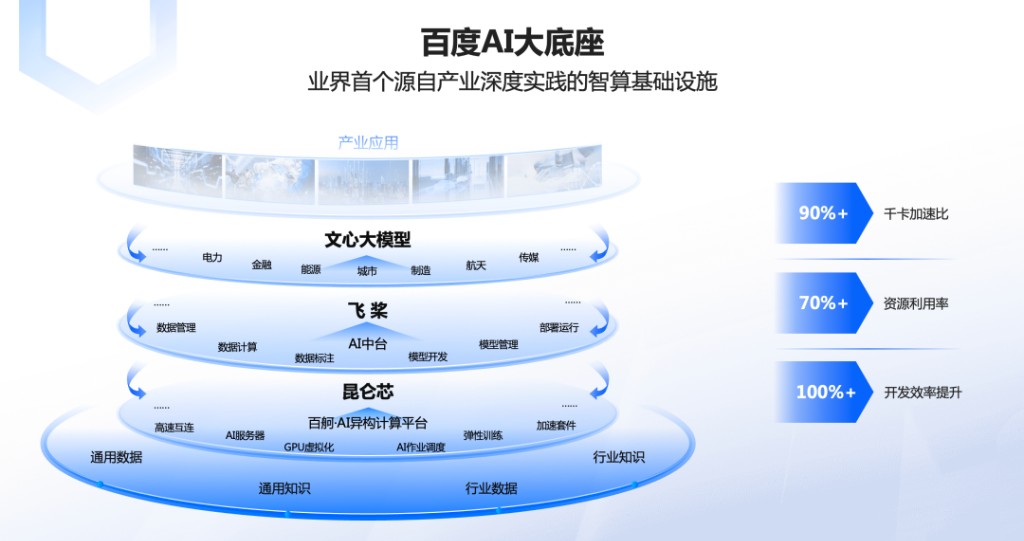

百度文心一言的落地設計,反映出人工智能時代 IT 技術的技術棧一個根本性變化:從過去 “芯片—操作系統—應用” 三層,演化成了 “芯片—框架—模型—應用” 四層。

其中,芯片層,百度有自主研發的 AI 通用處理芯片 “崑崙芯”;接着是飛槳深度學習框架,再到文心預訓練大模型和其他業務模型;最上層即搜索、智能雲、自動駕駛、小度等應用。

傳統機器學習過程,往往是由多個獨立模塊組成,每個步驟有自己獨立的任務,上一步驟模塊結果會影響下一步驟模塊,從而影響整個訓練結果和效率。

對比來看,在端到端深度學習模型下,從輸入端到輸出端會有一個預測結果,雖然各層在傳輸過程中會得到一個誤差,但模型會進行自我調整,直到得出預期效果結束。

這種端到端的架構,省去了機器學習過程中每個獨立模塊執行任務時的數據標註成本。

忻舟介紹,就大模型核心技術而言,目前國內外其實是沒有代差的,更多差距就體現在工程優化、數據和用户反饋上。

針對數據部分,他進一步解釋稱,中文語言數據複雜程度遠超英文語言,以 “我” 的表達方式為例,英文語境下表達方式就是 “I、me”,而中文裏可能有 26 種表達方式,這就增加了數據處理難度。

尤其是在當前百度數據標註工作均由內部工程師和產品經理完成的情況下,一套智能輔助標註系統或者優化算法就顯得非常必要。

“誰能夠把標數據的成本降低到更低,使得標數據的難度不那麼高,這個就是一個核心競爭力。” 忻舟説。

而四層 IT 技術架構的推出,在百度看來,能夠實現端到端優化,大幅提升效率;尤其是框架層和模型層之間,有很強的協同作用,可以構建更高效的模型,並顯著降低成本。

大模型技術棧的變化,也將徹底改變雲計算行業的產業規則,也將為垂類賽道和創新企業帶來新的機遇。

一個可見的趨勢是,主流商業模式正從 IaaS 變成 MaaS(模型即服務),即按算力、存儲等基礎設施服務能力收費轉向 “模型 + 應用” 收費模式。

百度創始人兼董事長李彥宏就曾預言,未來企業選擇雲廠商更重要是的看模型好不好,以及芯片、框架、模型、應用這四層之間的協同是否高效。

AI 大模型浪潮開啓了一個新時代,當所有產品被重建、規則被重塑,企業面臨的除了機遇還有挑戰,誰能更快迭代技術、落地產品,誰才能啓動增長飛輪。